Основы машинного обучения

Фундаментальный курс для тех, кто только начинает. Объясняем, как машина «учится» на данных: от постановки задачи до оценки качества модели. Разбираем ключевые концепции: bias-variance tradeoff, loss function, gradient descent, cross-validation.

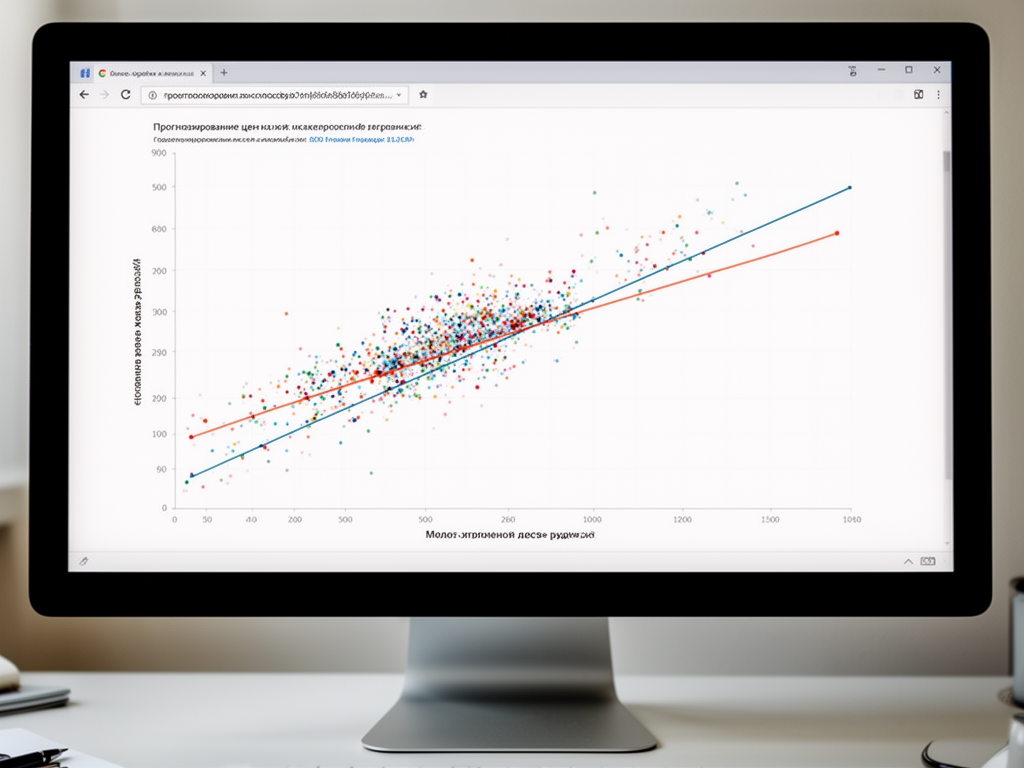

Обучение с учителем

Полный разбор алгоритмов supervised learning: линейная и логистическая регрессия, деревья решений, случайный лес, SVM, метод k-ближайших соседей, ансамблевые методы. Для каждого — математика, код и разбор на реальных данных.

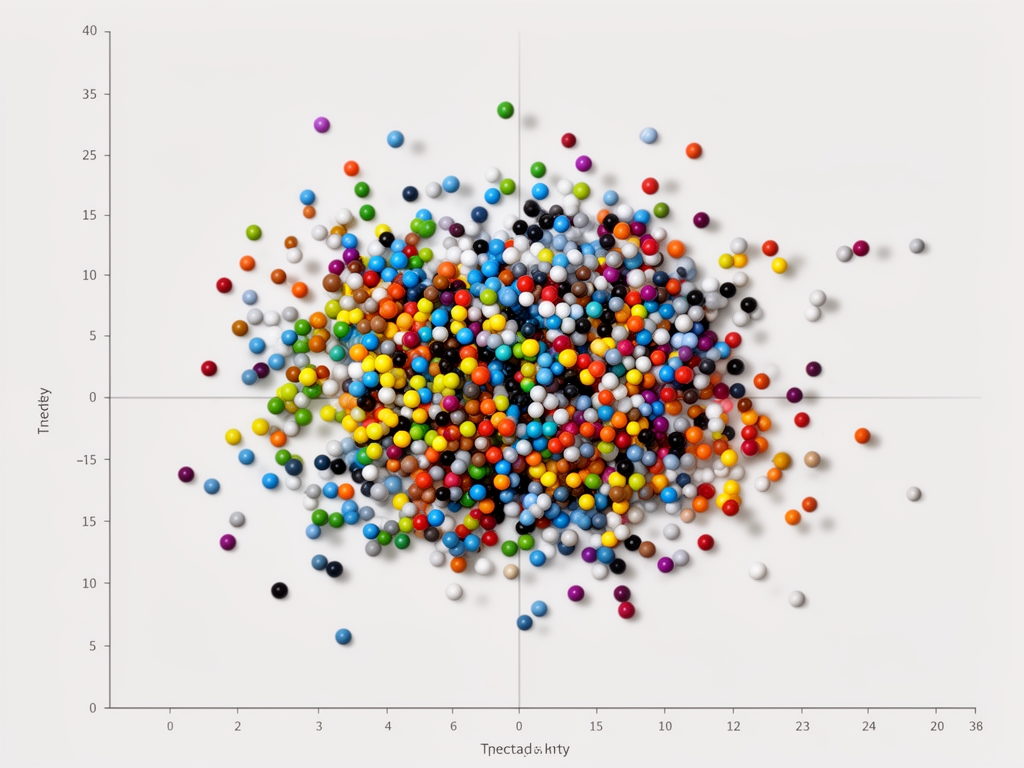

Обучение без учителя

Кластеризация, снижение размерности, выявление аномалий. Алгоритмы k-means, DBSCAN, иерархическая кластеризация, PCA, t-SNE, автоэнкодеры. Разбираемся, как находить структуру в данных без разметки.

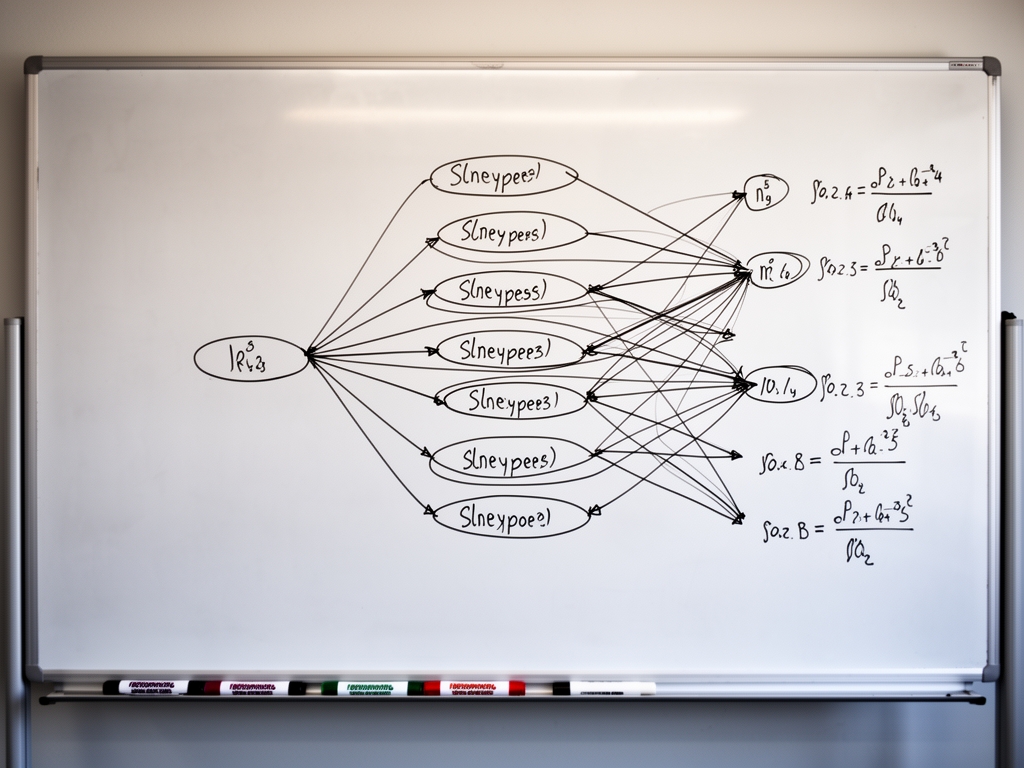

Нейронные сети и глубокое обучение

Архитектура нейрона, перцептрон, многослойные сети, функции активации, backpropagation, оптимизаторы. Свёрточные сети (CNN), рекуррентные сети (RNN, LSTM). Реализация на PyTorch.

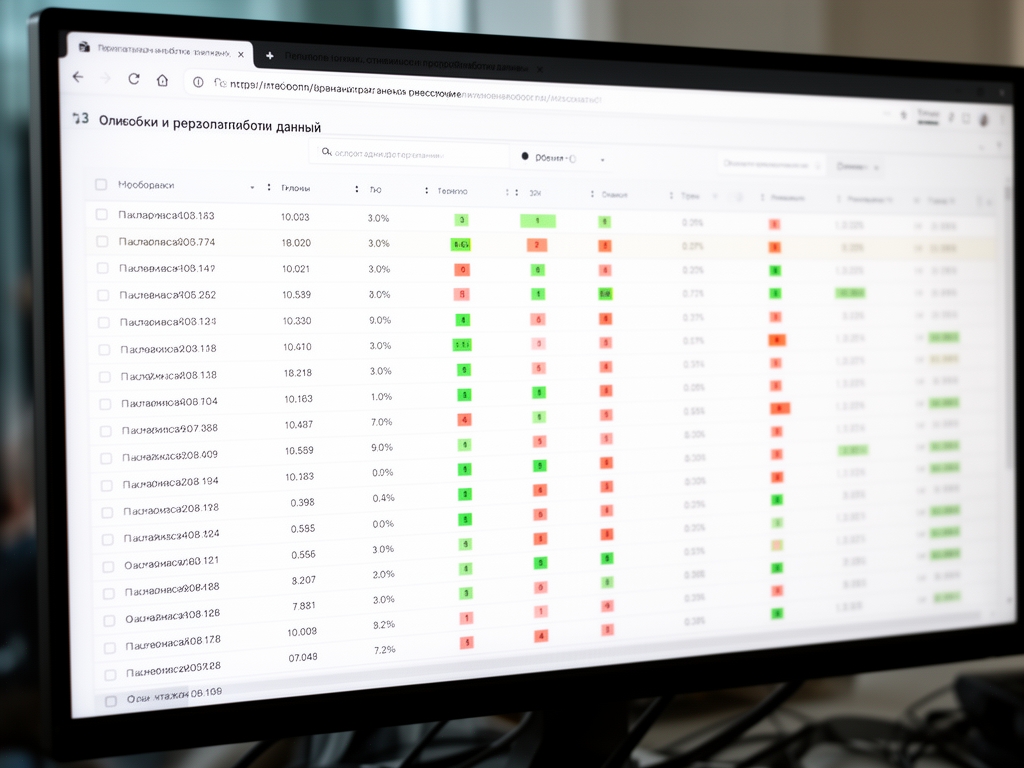

Предобработка и инженерия признаков

Работа с пропущенными значениями, нормализация, стандартизация, кодирование категориальных признаков, отбор признаков, работа с выбросами. Pandas и NumPy на практических примерах с реальными датасетами.