О чём этот курс

Нейронные сети — это не «чёрный ящик». Это конкретный класс параметрических функций, оптимизируемых с помощью градиентного спуска на вычислительных графах. Этот курс разбирает их именно так.

Мы начинаем с одного нейрона и логистической регрессии, показываем, почему добавление слоёв даёт принципиально новые возможности, объясняем алгоритм обратного распространения ошибки через цепное правило — и строим полноценные архитектуры на PyTorch.

Ключевые архитектуры

MLP

Многослойный перцептрон — базовая архитектура для таблиц

CNN

Свёрточные сети — для изображений и пространственных данных

RNN / LSTM

Рекуррентные сети — для последовательностей и временных рядов

Autoencoder

Автоэнкодеры — сжатие представлений и генерация

Учебная программа

▶Биологическая аналогия и её ограничения

▶Линейное преобразование и функция активации

▶Геометрический смысл нейрона

▶Логистическая регрессия как один нейрон

▶Sigmoid: свойства и проблема насыщения

▶Tanh: центрирование выходов

▶ReLU и его варианты: Leaky, ELU, GELU

▶Softmax для многоклассовой классификации

▶Теорема универсальной аппроксимации

▶Прямое распространение (forward pass)

▶Матричная запись вычислений

▶Инициализация весов: Xavier, He

▶Цепное правило дифференцирования

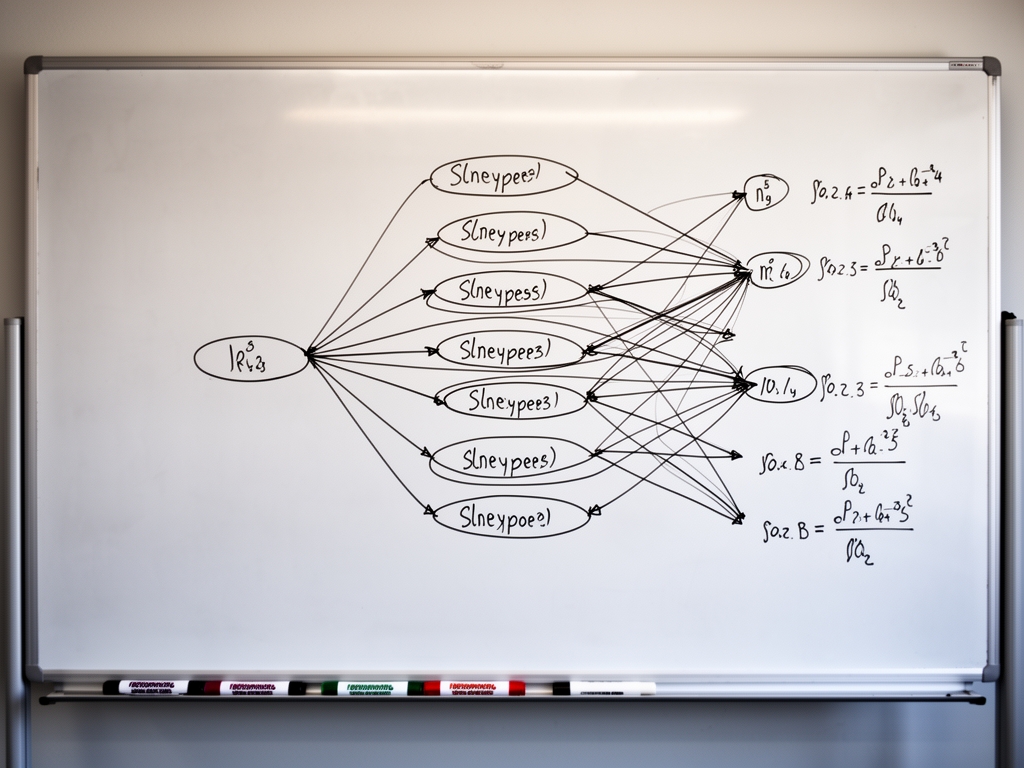

▶Вычислительный граф и обратный проход

▶Реализация с нуля на NumPy

▶Сравнение с автодифференцированием PyTorch

▶SGD с импульсом

▶RMSProp: адаптивный learning rate

▶Adam: момент первого и второго порядка

▶Learning rate scheduling

▶Dropout: теория и реализация

▶Batch Normalization: нормализация активаций

▶Weight decay и L2

▶Ранняя остановка обучения

▶Операция свёртки и пулинга

▶Рецептивное поле и иерархия признаков

▶Классические архитектуры: LeNet, AlexNet

▶Практика: классификация CIFAR-10

▶Рекуррентная ячейка: формула и ограничения

▶Проблема затухающего градиента

▶LSTM: ворота и ячейка памяти

▶GRU: упрощённая версия LSTM

▶Dataset и DataLoader

▶Определение модели через nn.Module

▶Цикл обучения: loss, backward, step

▶TensorBoard для визуализации обучения

▶Кривые обучения и их интерпретация

▶Анализ градиентов и vanishing/exploding

▶Визуализация активаций и весов

▶Методы поиска ошибок в архитектуре

▶Encoder-decoder архитектура

▶Латентное пространство и его свойства

▶Вариационный автоэнкодер (VAE)

▶Применение: снижение размерности и генерация