Что изучается в курсе

Supervised learning — наиболее широко применяемая парадигма машинного обучения. Этот курс систематически разбирает каждый ключевой алгоритм: откуда он берётся, как оптимизируется, в каких условиях работает лучше или хуже конкурентов.

Охватываемые алгоритмы

◆Линейная регрессия

◆Логистическая регрессия

◆Дерево решений (CART)

◆Случайный лес

◆Gradient Boosting (XGBoost)

◆Метод опорных векторов (SVM)

◆K-ближайших соседей

◆Наивный Байес

Модуль 1: Линейная регрессия4 раздела

МНК и градиентная оптимизация

Многомерная регрессия

Полиномиальные признаки

Диагностика остатков и VIF

Модуль 2: Логистическая регрессия4 раздела

Сигмоидная функция и вероятности

Оптимизация через кросс-энтропию

Многоклассовая: OvR vs Softmax

Интерпретация коэффициентов

Модуль 3: Деревья решений4 раздела

Критерии разбиения: Gini, Entropy

Рост дерева и его ограничение

Переобучение деревьев

Важность признаков

Модуль 4: Ансамблевые методы4 раздела

Bagging и Random Forest

Out-of-bag оценка

Gradient Boosting: последовательные ошибки

XGBoost и LightGBM

Модуль 5: SVM4 раздела

Максимизация зазора (margin)

Мягкий зазор и параметр C

Ядерный трюк: RBF, polynomial

Практика на нелинейно разделимых данных

Модуль 6: k-NN4 раздела

Метрики расстояния

Проблема размерности (curse of dimensionality)

Выбор k: cross-validation

KD-Tree и Ball-Tree для ускорения

Модуль 7: Наивный Байес4 раздела

Теорема Байеса для классификации

Гауссовый, Мультиномиальный, Бернулли

Сглаживание Лапласа

Применение: текст, спам, медицина

Модуль 8: Сравнение и выбор алгоритма4 раздела

No Free Lunch теорема

Критерии выбора алгоритма

Hyperparameter tuning: Grid/Random/Bayesian

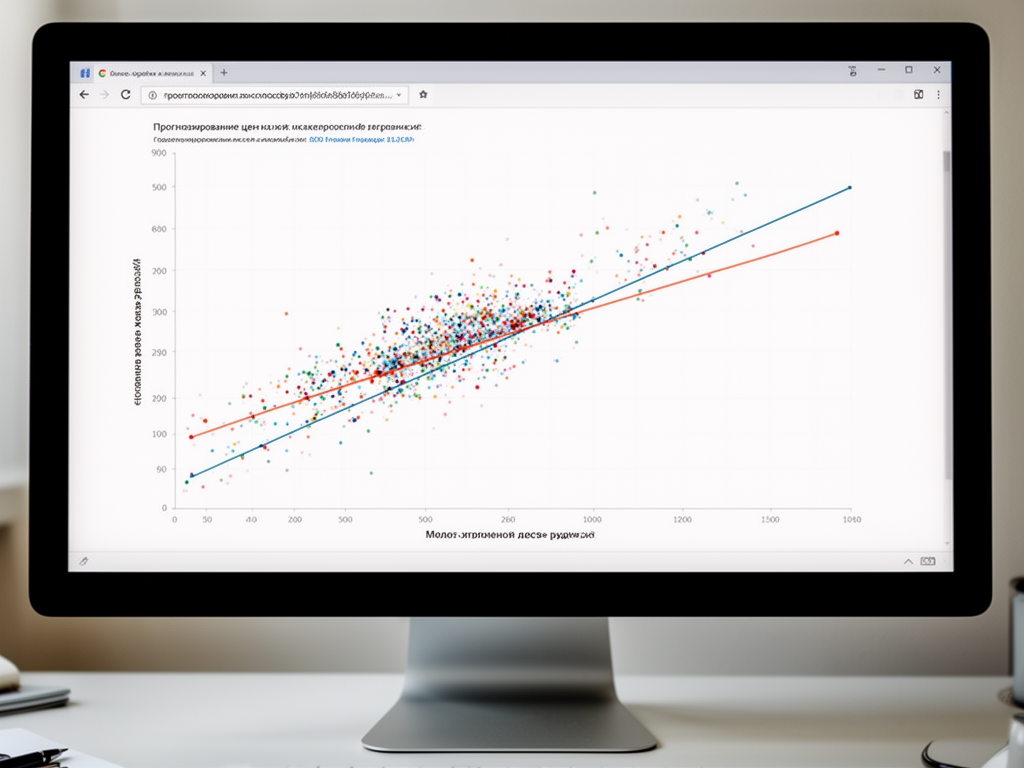

Итоговый проект: California Housing