Почему предобработка критична

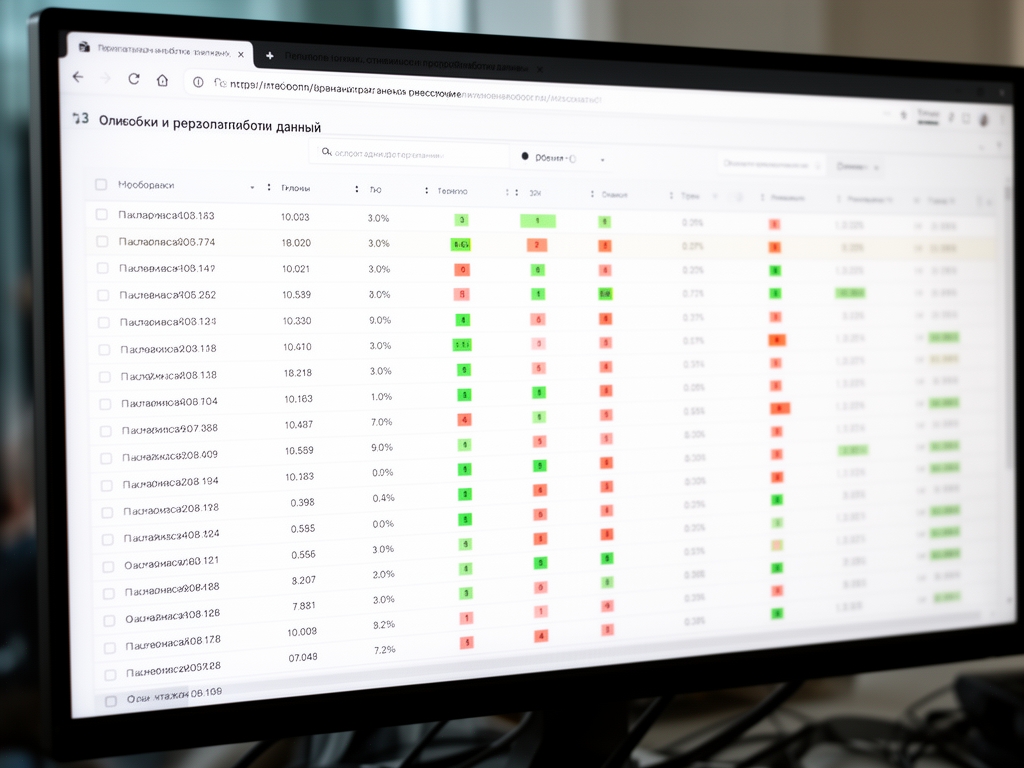

Алгоритмы ML чрезвычайно чувствительны к качеству входных данных. Пропущенные значения, выбросы, неправильно закодированные категориальные переменные, признаки с разными диапазонами — всё это может привести к некорректным или неустойчивым моделям.

Этот курс охватывает весь пайплайн подготовки данных — от импорта сырого датасета до передачи подготовленных матриц признаков в алгоритм обучения.

Модуль 1: Работа с пропусками4 раздела

Типы пропущенных значений: MCAR, MAR, MNAR

Удаление vs импутация

Стратегии: median, mean, mode, KNN imputation

Индикаторные признаки пропусков

Модуль 2: Масштабирование признаков4 раздела

Стандартизация (Z-score normalization)

Min-max нормализация

Robust Scaler для данных с выбросами

Влияние масштабирования на алгоритмы

Модуль 3: Кодирование категорий4 раздела

One-Hot Encoding и проблема dummy variable

Label Encoding: когда применимо

Target Encoding с регуляризацией

Ordinal Encoding для порядковых переменных

Модуль 4: Работа с выбросами4 раздела

Метод IQR для обнаружения выбросов

Z-score критерий

Winsorizing vs удаление

Выбросы в зависимой переменной

Модуль 5: Инженерия признаков4 раздела

Полиномиальные и взаимодействующие признаки

Преобразование распределений: log, Box-Cox

Временные признаки из дат

Агрегации и групповые статистики

Модуль 6: Отбор признаков4 раздела

Filter methods: корреляция, variance threshold

Wrapper methods: RFE

Embedded methods: Lasso, tree importance

Финальный пайплайн с scikit-learn Pipeline